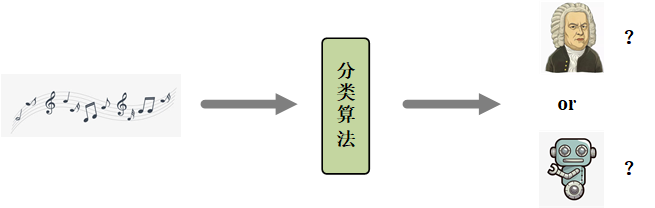

人 工 智 能 作 曲

识 别 比 赛

本次挑战赛的目的是对人工智能生成的单旋律音乐进行识别。比赛提供一个由若干种算法生成的,包含两种不同音乐风格的开发集旋律数据库, 供参赛者进行算法开发。一个月后公布一个验证数据集。比赛的最终成绩,由参赛者所开发算法对于验证集中旋律来源判断的AUC决定。

本次比赛没有报名流程,最终按期提交比赛结果者即视为报名参赛。参赛者使用所开发算法,对验证数据集中的旋律进行判断, 使用csv文件将验证数据集中旋律来源标记好后, 通过CSMT会议论文提交系统(https://cmt3.research.microsoft.com/CSMT2020) 将含有标签的csv文件和描述所开发算法的技术报告副本提交完毕后,即视为参赛成功。

提交的技术报告应当遵守第八届全国声音与音乐技术会议的投稿要求(中英文均可),并在比赛截止日期前提交至arXiv上, 投稿要求请详见本站相关页面。提交结果时请注意提交系统中的Track选择为“Data Challenge”。

参赛者需要提交源代码用于系统验证(必要时可以签署源代码保密协议)。 参赛者如在组委会要求时拒绝提供源代码,则其参赛资格自动取消。 代码可以使用任何编程语言。需要实现读取评估数据集,计算,生成系统输出的功能,并且说明使用到的第三方库。

参赛者禁止对验证集数据进行主观判断和标注。如若使用,一经发现则其参赛资格自动取消。

开发数据集

开发数据集只含人工智能算法生成的音乐,包含了6000个MIDI文件,每个文件为单旋律音乐,曲速在68bpm到118bpm之间, 每首旋律长度为8小节,不包含完整的乐句结构。需要注意的是, 开发数据集中的旋律由两个音乐风格完全不同的数据库分别训练若干种不同音乐生成模型后,由算法生成。开发集中的MIDI文件以下面的方式命名。

development-id.mid

评估数据集

评估数据集包含4000个MIDI文件,除以下两点外,所有设置均与训练集相同。1)加入了一定量的作曲家的作品,其中一些为已经发表的作品, 而另外一些为未发表的作品,这些作品的风格,经音乐学家鉴定,与训练算法使用的两个数据库的音乐风格分别相同。 2)评估集中存在一些由与开发集中稍微不同的算法所生成的旋律。评估集中的MIDI文件以下面的方式命名。

test-id.mid

比赛的最终成绩,以参赛者对评估集数据判断的结果为准。

数据下载

本次比赛可以使用外源数据,但必须符合以下要求。

• 外源数据必须为开源数据,并且可以被引用。

• 外源数据可以是公开的数据集或者预训练好的模型,这些数据必须在2020年8月15日前公开并免费提供。

• 参赛者需要在技术报告中将使用过的外源数据详细列出。

参赛者需要提交一个打包的zip文件,该zip包括一份技术报告和一份二级zip文件:

• 对系统作出详细解释的技术报告(*.pdf),技术报告需要匿名化,并且符合CSMT的投稿要求。

• 二级zip文件中需要包含:1.可以运行的完整代码。2.系统的输出文件(*.csv),系统输出文件应为单个文件(CSV格式,带有标题行),其中包含评估数据集中 每一个MIDI文件的得分(浮点数类型),分值越高代表越有可能为人类创作的音乐,分值越低代表越有可能为AI生成的音乐,如下表所示。

请注意:一个ZIP文件内可以包含多个CSV文件,即包含多种检测方法,但ZIP文件中的源代码应当能够生成所有提供的CSV文件。

file_name score

0.mid 0.8

1.mid 0.25

2.mid 0.6

3.mid 0.1

为了避免参赛者提交的文件重名,请使用以下规则来命名提交的文件。

[first name]_[last name]_[Abbreviation of institute of the corresponding author]

如下面的例子所示。

• Hua_Li_BUPT

• Michael_Jordan_UNC

确保提交的zip文件遵循以下的目录结构。zip包示例可以这里下载。

Hua_Li_BUPT.zip Zip-package root, Task submissions

│

└───Hua_Li_BUPT_technical_report.pdf Technical report

│

│

└───output_code.zip

Hua_Li_BUPT_code_1 Task System code

(Any language is allowed)

Hua_Li_BUPT_output_1.csv Task System output

Hua_Li_BUPT_code_2 Task System code

Hua_Li_BUPT_output_2.csv Task System output

该基线系统采用自编码器的结构。编码器,解码器分别为四层的全连接层。 训练时,只针对AI生成的音乐训练自编码器。通过训练,解码器学习到如何生成AI音乐的分布。 推断时,不同来源的音乐通过自编码器得到输出,由于自编码器只学习到了AI音乐的分布, 所以,对AI音乐的重构效果要优于对人类音乐的重构效果。 计算解码器输出与原始输入的重构损失,将重构损失低的判定为AI生成的音乐,重构损失高的判定为人类作的音乐。

联系我们:井音吉,赛事协调员,北京邮电大学,联系邮箱jyj@bupt.edu.cn

需要对风格进行分类吗?

不需要对风格进行分类。

本次比赛只需要对人类创作的音乐和AI生成的音乐进行判断,

但参赛者需要注意的是,数据集中有多种风格的音乐。